Los agentes de IA han pasado rápidamente de demostraciones impresionantes a herramientas reales capaces de actuar en su nombre, y OpenClaw es uno de los proyectos que ha llevado este tema al centro de la atención. Probablemente haya visto el mismo software llamado Clawdbot o Moltbot, nombres que su creador, el desarrollador austriaco Peter Steinberger, usó en distintas fases de desarrollo.

Se promueve como un asistente personal que actúa por usted sin intervención continua, pero también plantea preguntas importantes sobre acceso y seguridad.

- Los agentes de IA son sistemas de IA con capacidad de acción, no solo herramientas conversacionales.

- Herramientas como OpenClaw demuestran el poder de los agentes de IA autohospedados.

- Ese poder introduce nuevos riesgos de seguridad cuando los agentes procesan datos no confiables.

- La inyección de instrucciones (prompt injection) es una amenaza clave para los agentes de IA, incluso más que para los chatbots.

- La memoria persistente puede amplificar errores y prolongar los ataques.

- Los agentes de IA son poderosos, pero no deben considerarse una opción segura por defecto para la mayoría de los usuarios.

¿Por qué tanto ruido alrededor de OpenClaw?

OpenClaw atrae atención porque representa el paso de IA que responde preguntas a IA que puede ejecutar tareas en un sistema real e incluso usar software. Los posibles problemas de seguridad han hecho que más gente en los círculos de seguridad comience a hablar sobre OpenClaw. ¿Qué lo hace atractivo para desarrolladores y usuarios avanzados?

OpenClaw destaca porque puede tomar acciones reales, no solo generar texto o sugerencias. En lugar de decirle a usted qué hacer, puede hacerlo por sí mismo. La tecnología puede abrir aplicaciones, enviar mensajes, mover archivos, ejecutar comandos e interactuar con sistemas directamente en su nombre.

Ese nivel de automatización es lo que despierta interés. Desarrolladores y usuarios avanzados ven el control a nivel de sistema como una manera de reducir tareas repetitivas o automatizar flujos de trabajo. La idea de un agente de IA que “hace el trabajo” en lugar de limitarse a asistir desde la barrera resulta muy atractiva.

Esta promesa de capacidad práctica es la razón por la que OpenClaw pasó de ser un proyecto de nicho a un tema de discusión más amplio.

¿Por qué esto importa más allá de OpenClaw?

OpenClaw es un ejemplo visible de un cambio más amplio hacia agentes de IA que realmente actúan, no solo responden y aconsejan.

Cuando esta clase de tecnología crece, las preguntas sobre su uso indebido se vuelven inevitables. Lo que muestra OpenClaw es hacia dónde se dirige la IA. Eso lo hace relevante mucho más allá de un solo proyecto y marca el inicio de debates continuos sobre cómo deben controlarse estos agentes. ¿Se les puede confiar?

¿Qué son los agentes de IA y en qué se diferencian de otras herramientas de IA?

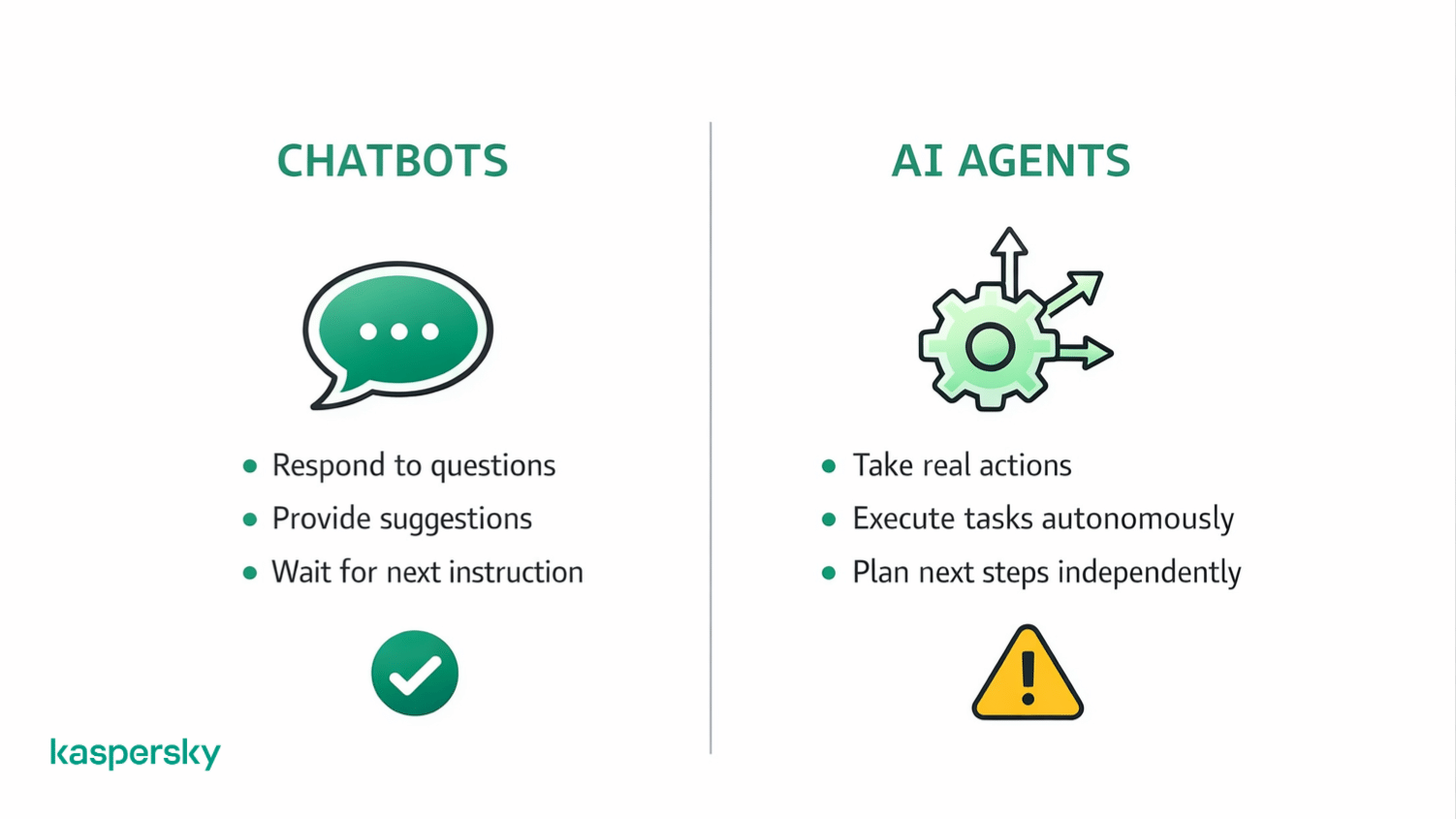

Los agentes de IA no se limitan a ofrecer respuestas en texto o audio a sus preguntas. Pueden planificar pasos y ejecutar acciones para alcanzar un objetivo. En lugar de quedarse en la recomendación, deciden qué hacer a continuación y lo ejecutan.

Un agente de IA puede observar una situación y actuar. Esto contrasta con la mayoría de las herramientas de IA, que responden a solicitudes pero esperan la siguiente instrucción. Ejemplos tempranos incluyen agentes que ejecutan tareas como Manus (ahora propiedad de Meta). Manus muestra cómo los agentes pueden avanzar más allá del chat hacia la acción: pueden ofrecer análisis de datos o incluso escribir código activamente para resolver problemas sin que se les pida explícitamente, reduciendo la intervención humana.

OpenClaw se basa en esta misma idea de agentes con capacidad de acción, pero la aplica de forma más directa y potente.

¿OpenClaw es un agente de IA típico o algo más avanzado?

OpenClaw encaja dentro de la categoría de agentes de IA, pero ofrece una implementación más poderosa que muchas de las herramientas con las que la gente está familiarizada hoy en día.

Esta herramienta de IA puede planificar tareas y actuar sin entrada constante. OpenClaw puede interactuar directamente con software y el sistema operativo, no solo con APIs o herramientas limitadas. Ese acceso más amplio aumenta su utilidad y lo diferencia. También eleva las apuestas y la importancia de la seguridad.

¿Por qué los agentes de IA autohospedados son diferentes?

Los agentes de IA autohospedados se ejecutan localmente en su propio equipo en lugar de en un servicio remoto. Eso da a los usuarios más control sobre la configuración y el comportamiento. Pero también cambia la responsabilidad.

Cuando un agente tiene acceso local, la seguridad depende de cómo se configure, qué permisos tenga y cómo se supervise. Más control implica más riesgo.

Proyectos recientes muestran cómo la idea de agentes de IA “autohospedados” está evolucionando. Por ejemplo, Moltbot (antes Clawdbot) ahora puede ejecutarse usando Moltworker, la solución de código abierto de Cloudflare. Esto elimina por completo la necesidad de hardware local dedicado al correr el agente en una plataforma administrada.

Esto reduce la barrera de entrada y simplifica la puesta en marcha, pero también desplaza dónde reside el control. Si un agente se ejecuta en infraestructura en la nube, la seguridad depende no solo del agente, sino también de controles de acceso, y de cómo se manejan permisos y datos en toda la plataforma.

Por ejemplo, un usuario puede conectar un agente de IA a su correo electrónico esperando que solo lea mensajes, mientras que la configuración en la nube también le permite enviar correos a menos que esa autorización se desactive explícitamente.

¿En qué se diferencian los agentes de IA de chatbots como ChatGPT?

Los chatbots como ChatGPT responden; los agentes de IA actúan.

Un chatbot puede ofrecer sugerencias o explicaciones. Un agente de IA puede abrir programas o ejecutar flujos de trabajo de forma activa.

Por ejemplo, algunas personas han usado OpenClaw para automatizar operaciones de trading. Han definido reglas y pedido a un agente de IA no solo que dé consejos (lo que podría hacer ChatGPT), sino que ejecute operaciones por sí mismo.

¿Por qué los agentes de IA introducen nuevos riesgos de seguridad?

Como se dijo antes, los agentes de IA toman acciones en lugar de limitarse a dar consejos. Esto suele ir acompañado de acceso a archivos, aplicaciones o funciones del sistema.

El acceso y la autonomía que concede OpenClaw cambian tanto el impacto como el riesgo. OpenClaw pedirá permiso para interactuar con software o ejecutar acciones como enviar un correo o rellenar formularios sin supervisión. Eso lo convierte en una incógnita.

Los errores o las manipulaciones pueden tener consecuencias reales. El riesgo no solo es lo que se le ordena hacer al agente, sino cómo interpreta instrucciones mientras realiza una tarea.

¿Por qué la entrada no confiable es un problema central?

Los agentes de IA consumen grandes cantidades de contenido externo (páginas web, documentos, etc.) para decidir qué hacer a continuación. Ese contenido no siempre es confiable.

Las instrucciones no tienen que ser explícitas. Pueden estar ocultas en texto o datos que el agente lee mientras realiza una tarea. Esto permite que atacantes influyan en el comportamiento de un agente sin interactuar directamente con él.

Este problema abre una vía clara hacia la inyección de instrucciones (prompt injection): cuando entradas no confiables se usan para dirigir a un agente a tomar acciones que nunca debería ejecutar.

Las herramientas de IA potentes requieren protección más fuerte

Los agentes de IA pueden acceder a archivos, correos y funciones del sistema. Kaspersky Premium ayuda a detectar actividad sospechosa, bloquear scripts maliciosos y proteger sus dispositivos de amenazas reales en el mundo digital.

Pruebe Kaspersky Premium gratis¿Qué es la inyección de instrucciones (prompt injection) en agentes de IA?

La inyección de instrucciones es una técnica para manipular a un agente de IA alimentándolo con contenido no confiable que altera su comportamiento.

El riesgo no es un fallo técnico en el código. Es que el agente trate entradas externas —como mensajes o comentarios— como si fueran órdenes. Cuando eso ocurre, el agente puede ser guiado a ejecutar acciones para las que nunca fue diseñado.

¿Cómo funciona la inyección de instrucciones en escenarios reales?

La inyección de instrucciones puede ser directa o indirecta.

- Directa: un atacante incluye deliberadamente instrucciones en el contenido que el agente procesa.

- Indirecta: el agente recoge instrucciones ocultas o inesperadas de un sitio web o mensaje durante tareas normales.

El problema clave es el comportamiento. El agente puede seguir lo que interpreta como orientación, incluso si provino de fuentes no confiables. No se necesita un bug de software para que esto ocurra.

¿Por qué la inyección de instrucciones es más peligrosa para agentes de IA que para chatbots?

Las instrucciones inyectadas suelen afectar las respuestas y consejos de los chatbots. Con los agentes de IA, pueden afectar acciones reales.

Si un agente tiene acceso a archivos o controles del sistema, las instrucciones manipuladas pueden provocar cambios en el mundo real. Por eso la inyección de instrucciones representa un riesgo mayor para los agentes: la misma técnica que altera la salida de texto en un chatbot puede desencadenar acciones no deseadas cuando está involucrado un agente.

¿Qué es la memoria persistente en agentes de IA?

La memoria persistente permite que un agente de IA conserve información a lo largo del tiempo. Significa que puede usar entradas pasadas para guiar decisiones futuras en lugar de empezar siempre desde cero.

¿Qué implica la memoria persistente para los agentes de IA?

Un agente de IA puede almacenar contexto e instrucciones entre sesiones y desarrollar ‘comportamientos’ preferidos. Esto ayuda a que trabaje con más eficiencia al recordar lo aprendido o lo que ya hizo.

También significa que entradas anteriores pueden influir en el comportamiento posterior. Instrucciones o supuestos recogidos en una tarea previa pueden seguir moldeando la actuación del agente en otra situación, incluso si el usuario ya no es consciente de ello.

¿Por qué la memoria persistente aumenta los riesgos de seguridad?

La memoria persistente puede introducir efectos retardados. Una instrucción dañina puede no causar problemas de inmediato, pero reaparecer más adelante cuando se den las condiciones adecuadas.

Esto complica la limpieza. El comportamiento almacenado puede repetirse en varias tareas. Restaurar completamente un agente a menudo requiere borrar la memoria o reconstruir la configuración para asegurarse de eliminar influencias no deseadas.

¿Qué sucede cuando un agente de IA está mal configurado o expuesto?

Un agente de IA puede ser accedido o manipulado de formas que su propietario nunca pretendió, convirtiendo una herramienta útil en un riesgo de seguridad potencial.

Esto puede ocurrir por accidente o por malentendidos. También puede suceder si terceros intentan manipular al agente.

¿Cómo los agentes de IA pueden quedar expuestos sin intención?

La exposición suele ocurrir por errores simples. Algo tan sencillo como una autenticación débil o permisos demasiado amplios puede hacer que un agente sea accesible desde fuera de su entorno previsto.

Ejecutar un agente localmente no garantiza automáticamente su seguridad. Si se conecta a internet o interactúa con otros sistemas, puede ser influido. El control local reduce algunos riesgos, pero no los elimina por completo.

¿Por qué los agentes de IA expuestos se convierten en superficies de ataque?

Una vez expuesto, un agente de IA se vuelve algo que los atacantes pueden sondear, probar y manipular. Pueden intentar alimentarlo con entradas especialmente diseñadas, desencadenar acciones o aprender cómo se comporta con el tiempo.

Dado que los agentes pueden realizar acciones reales, el abuso no tiene que parecer un hackeo tradicional. El uso indebido puede consistir en desviar su comportamiento, extraer datos o provocar cambios no deseados en el sistema, todo sin explotar un fallo clásico de software.

¿Qué es la “tríada letal” en la seguridad de agentes de IA?

La “tríada letal” describe tres condiciones que, combinadas, crean un riesgo serio de seguridad para los agentes de IA.

Las tres condiciones que facilitan ataques graves

- La primera condición es el acceso a datos sensibles, como archivos, credenciales o información interna.

- La segunda es la entrada no confiable, es decir, que el agente consuma contenido que no puede verificar por completo.

- La tercera es la capacidad de tomar acciones externas, como enviar solicitudes, modificar sistemas o ejecutar comandos.

Individualmente, estos factores pueden ser manejables. Son peligrosos cuando forman esta tríada. Un agente que lee entradas no confiables y puede actuar sobre ellas crea una vía clara para la manipulación. Controlar las acciones que se le permiten realizar a un agente es vital.

¿Deberían los usuarios cotidianos ejecutar agentes de IA hoy en día?

Para la mayoría de las personas, los agentes de IA siguen siendo herramientas experimentales. Pueden ser útiles en el entorno adecuado, pero también introducen riesgos nuevos que no siempre son evidentes.

¿Cuándo puede tener sentido usar un agente de IA?

Un agente de IA puede resultar apropiado en escenarios controlados y de bajo riesgo. Esto incluye experimentar en un dispositivo separado. Algunas personas ejecutan agentes que solo manejan tareas no sensibles, como organizar archivos o probar flujos de trabajo.

Por ejemplo, si desea que el agente cree un itinerario para un viaje, puede darle acceso a la información necesaria y evitar que pueda contactar a personas directamente o realizar acciones dañinas.

Si se siente cómodo gestionando la configuración y los posibles errores no tienen consecuencias graves, un agente puede ser una herramienta de aprendizaje. La clave es mantener el alcance pequeño y restringir el acceso al mínimo necesario.

¿Cuándo los agentes de IA son una mala idea?

Los agentes de IA no son adecuados cuando tienen acceso a datos sensibles o cuentas importantes. Ejecutar agentes sin comprender los permisos o los peligros de las entradas externas aumenta el riesgo rápidamente.

También es válido optar por no usarlos. Decidir no ejecutar un agente de IA hoy es razonable si la conveniencia supuesta viene a costa de la seguridad o la tranquilidad.

¿Qué medidas básicas de protección son esenciales al usar agentes de IA?

Las medidas de protección básicas ayudan a reducir riesgos y evitar que los errores se conviertan en problemas graves.

El software de Kaspersky puede aportar una capa adicional al señalar comportamientos sospechosos y ayudar a proteger cuentas contra accesos no autorizados. Nuestros planes protegen contra malware y virus, así como contra ransomware y aplicaciones espía.

¿Qué medidas de seguridad importan más?

El aislamiento es fundamental. Ejecute agentes en dispositivos y cuentas separados siempre que sea posible para que no afecten datos o sistemas importantes. Limite los permisos a lo estrictamente necesario. Recomendamos evitar otorgar acceso total al sistema o a cuentas por defecto.

También son útiles los pasos de aprobación. Exigir confirmación antes de acciones sensibles añade una pausa que puede prevenir comportamientos no deseados, como autorizar pagos en su nombre. Estos controles sencillos tienen un gran impacto sin añadir mucha complejidad.

¿Qué significan los agentes de IA para el futuro de la IA de consumo?

Los agentes de IA apuntan a un futuro en el que las herramientas de IA hacen más que asistir: actúan. Pero ese cambio conlleva compensaciones que los consumidores apenas comienzan a explorar.

¿Qué nos dice este momento sobre la madurez de los agentes de IA?

Los agentes de IA son poderosos pero inmaduros. Pueden automatizar tareas, pero todavía presentan limitaciones en juicio y seguridad. Esto no significa que no vayan a volverse más seguros o fiables, sino que las expectativas deben mantenerse realistas.

Los agentes de IA muestran hacia dónde se dirige la tecnología, pero su uso cotidiano y generalizado requerirá mejores salvaguardas y herramientas diseñadas con la seguridad desde el principio.

Artículos relacionados:

- ¿Cómo aborda ChatGPT los problemas de ciberseguridad y los riesgos potenciales?

- ¿Cuáles son los riesgos del cibercrimen con IA en el panorama digital actual?

- ¿Cómo mejoran la ciberseguridad la inteligencia artificial y el aprendizaje automático?

- ¿Cuáles son los peligros de la tecnología deepfake hoy en día?

Productos recomendados:

Preguntas frecuentes

¿Se puede descargar OpenClaw de forma gratuita?

OpenClaw se puede descargar gratuitamente en GitHub. Es software de código abierto. Esto significa que otras personas pueden modificarlo y redistribuirlo.

¿Es fácil configurar OpenClaw?

Existen tutoriales que permiten poner bots en funcionamiento con rapidez, pero una configuración sofisticada requiere tiempo y conocimientos especializados. Por eso mismo ejecutar software que no esté bien configurado supone un riesgo.